DeepSeek-V4接入Claude Code,实测离谱!

你好,我是郭震!

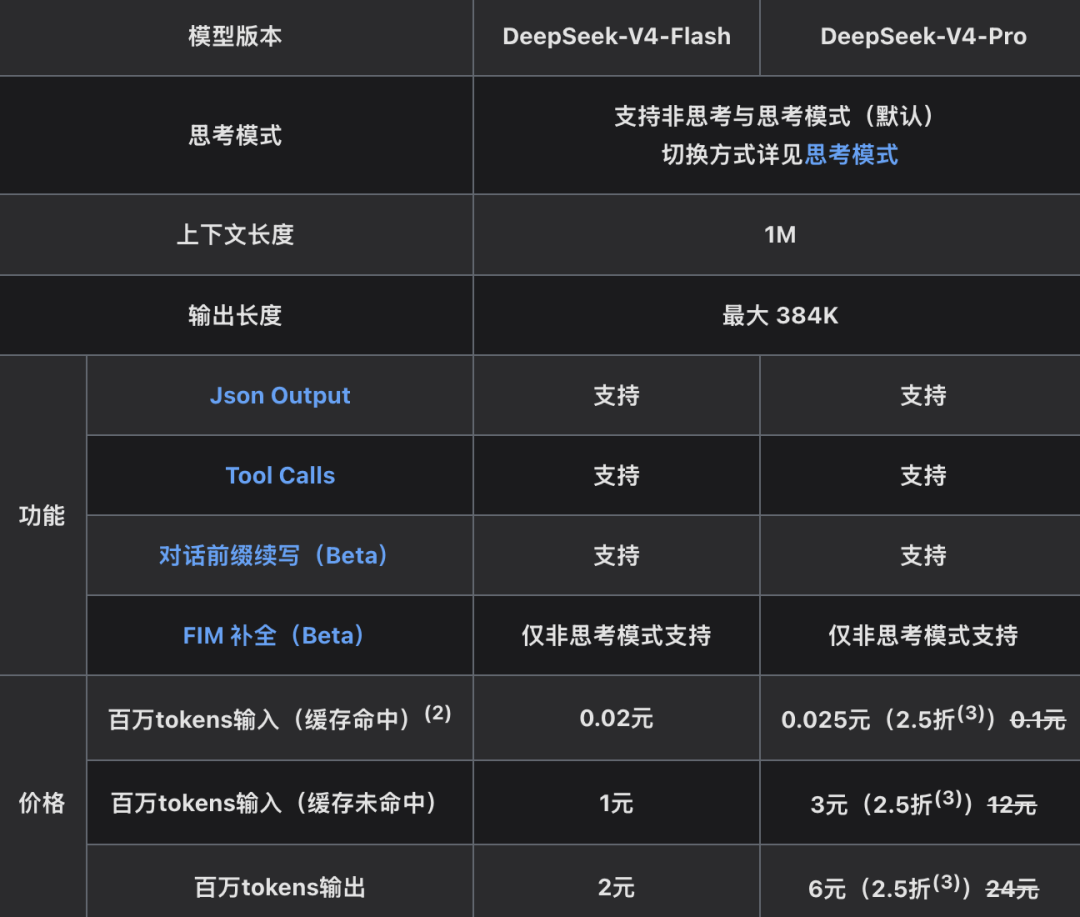

DeepSeek-V4 发布到现在已经一周多,V4 包含 Pro 和 Flash 两个模型。

今天这篇文章实测两个模型在Claude Code 中,从零开发一个完整小项目的能力对比,实测发现DeepSeek-V4-Flash离谱,Gemini-3.1-Pro给出的结论竟然好于DeepSeek-V4-Pro,感兴趣的读者可以看看。

** 1 DeepSeek-V4**

在开始之前,先看一眼官方的价格表:

对于编程 Agent 来说,它需要频繁地读取你的整个代码库(Context),Token 消耗大。如果你用Claude,跑一个稍微大点的项目,几十块钱瞬间就没了。

但换成** DeepSeek-V4**,性价比就会好很多。

** 2 从零安装与接入 Claude Code 模式**

目前顶级的终端编程体验莫过于 Anthropic 推出的 Claude Code,并把核心大脑换成 DeepSeek-V4。

** 第一步:安装Claude Code**

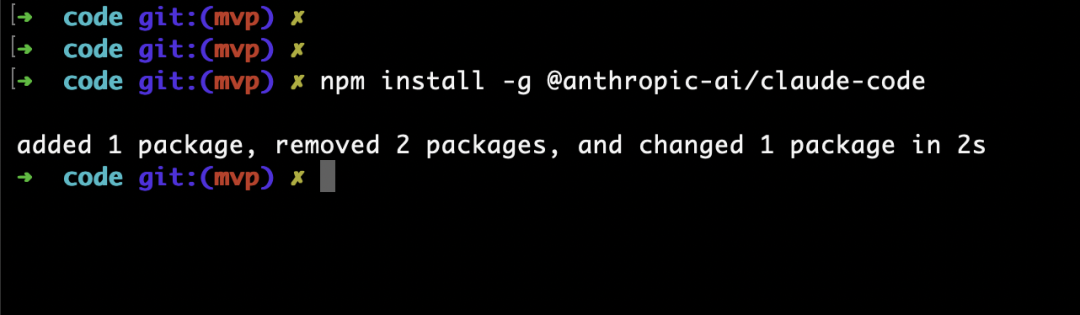

执行下面命令:

npm install -g @anthropic-ai/claude-code

执行命令,结果如下所示表明安装上了:

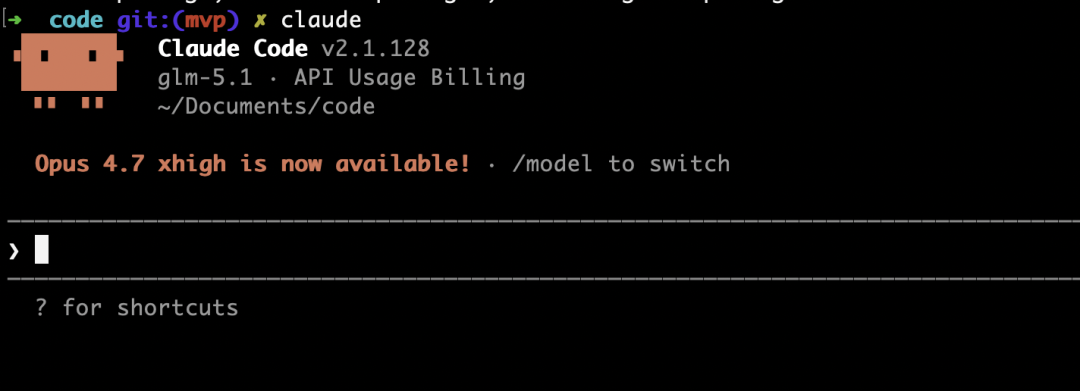

命令行输入 Claude,如下图所示,出来Claude Code开发界面:

看到我默认设置的是glm-5.1

其他国外算力估计很多读者不好接入,好消息是,这里我们可以设置为国产算力,并且接入比较容易。

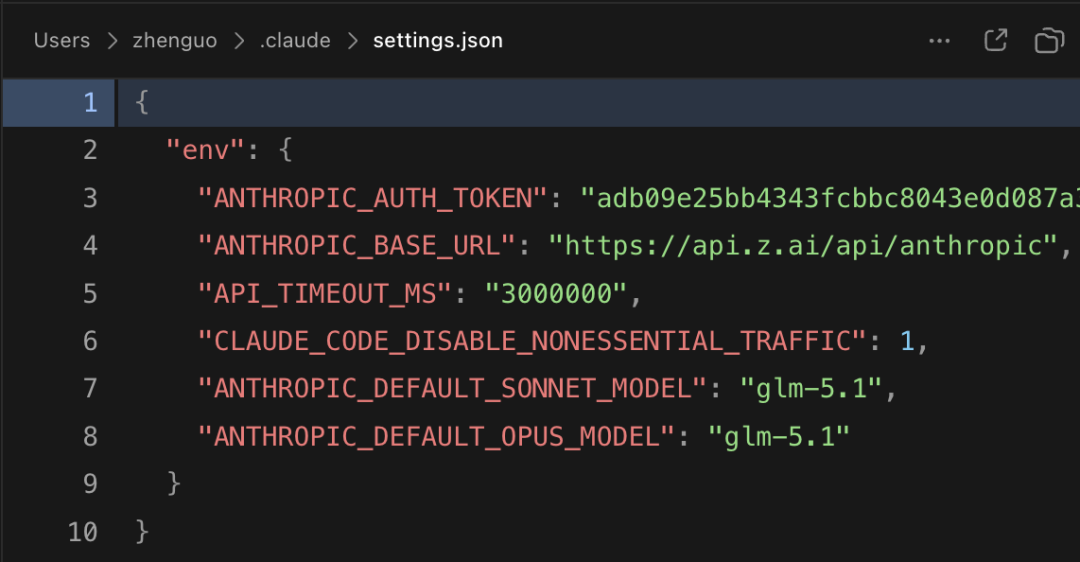

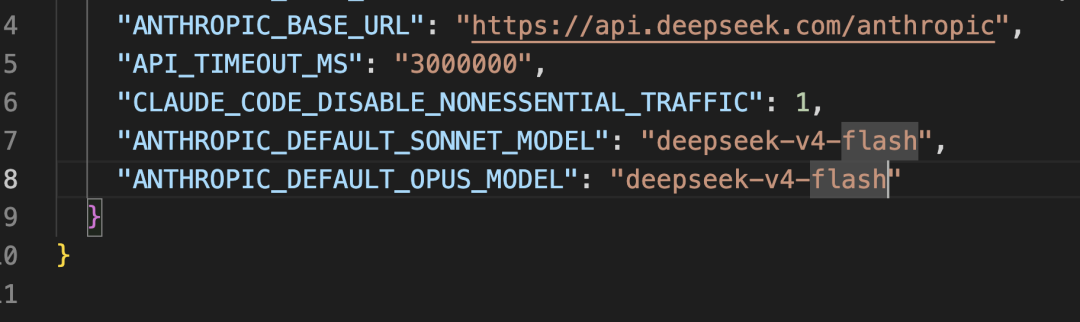

第二步:接入 DeepSeek-V4 算力

只需要在命令行作如下设置就行,mac用户,一般默认文件在home目录.claude的settings.json文件中:

直接修改为deepseek-v4-pro,base url 按照如下调整:

https://api.deepseek.com/anthropic

API key 配置为你自己的,保存。

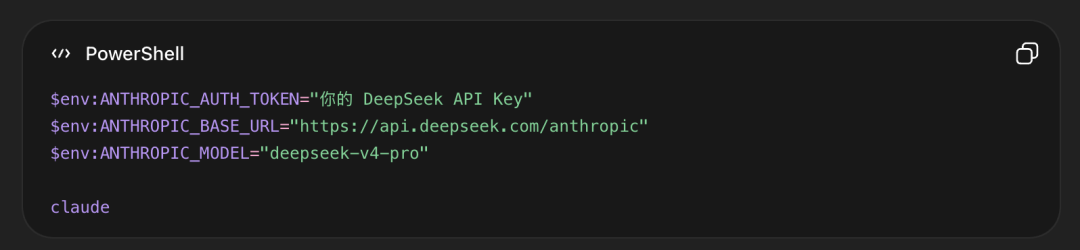

Windows电脑读者,在power shell中如下配置:

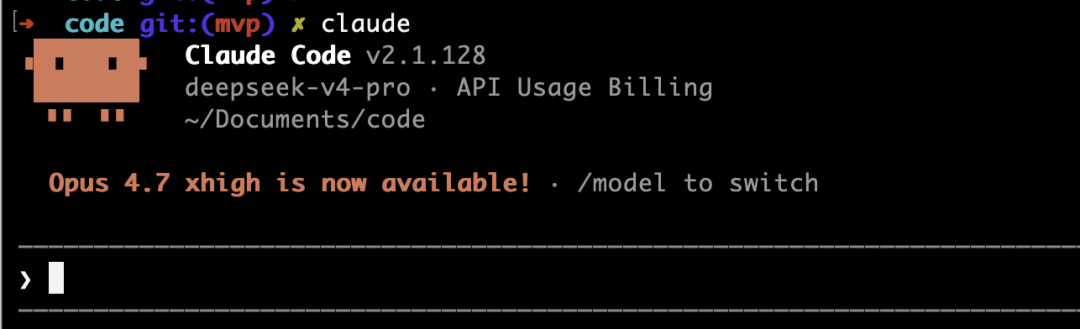

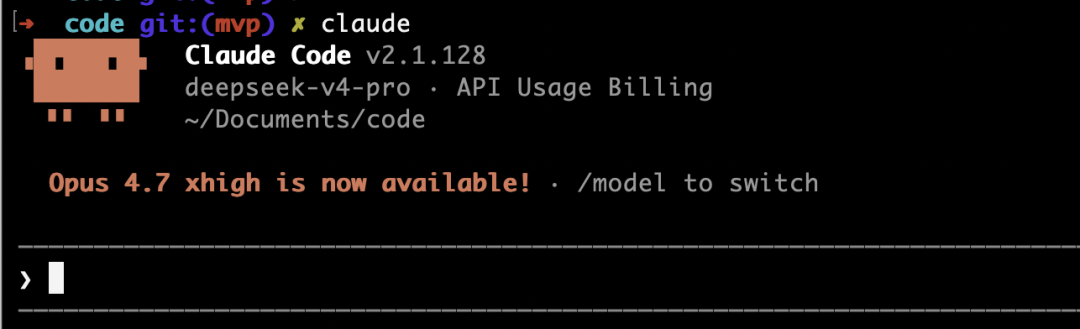

重启下Claude,如下图所示,此时就由glm-5.1调整为: deepseek-v4-pro:

提问一个Hi:

正常回复,表示已经Claude Code已经成功接入DeepSeek-V4算力。

3 DeepSeek-V4-Pro从零开发项目

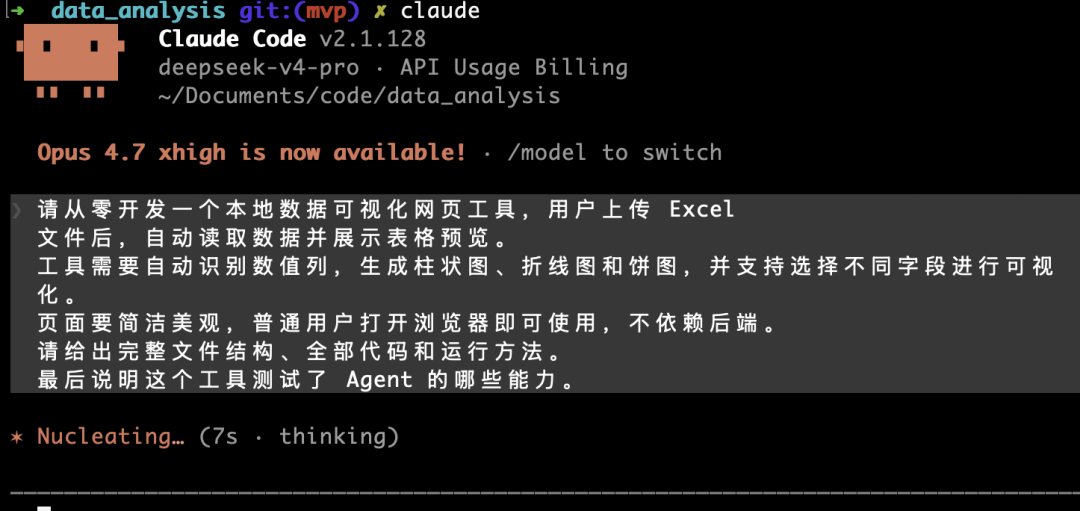

我给它下达了一个任务:** **

请从零开发一个本地数据可视化网页工具,用户上传 Excel 文件后,自动读取数据并展示表格预览。

工具需要自动识别数值列,生成柱状图、折线图和饼图,并支持选择不同字段进行可视化。

页面要简洁美观,普通用户打开浏览器即可使用,不依赖后端。

请给出完整文件结构、全部代码和运行方法。

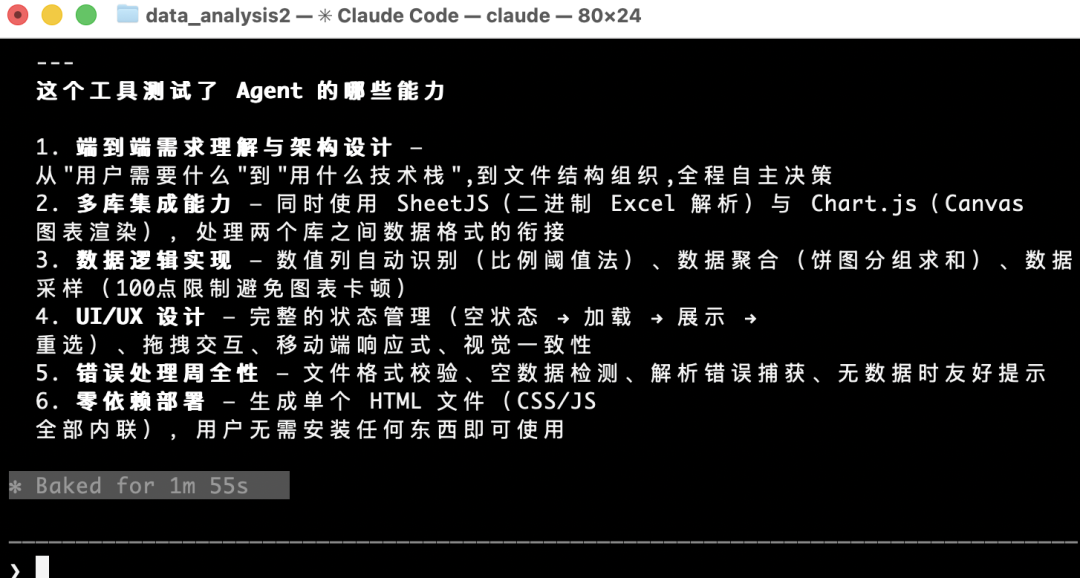

最后说明这个工具测试了 Agent 的哪些能力。

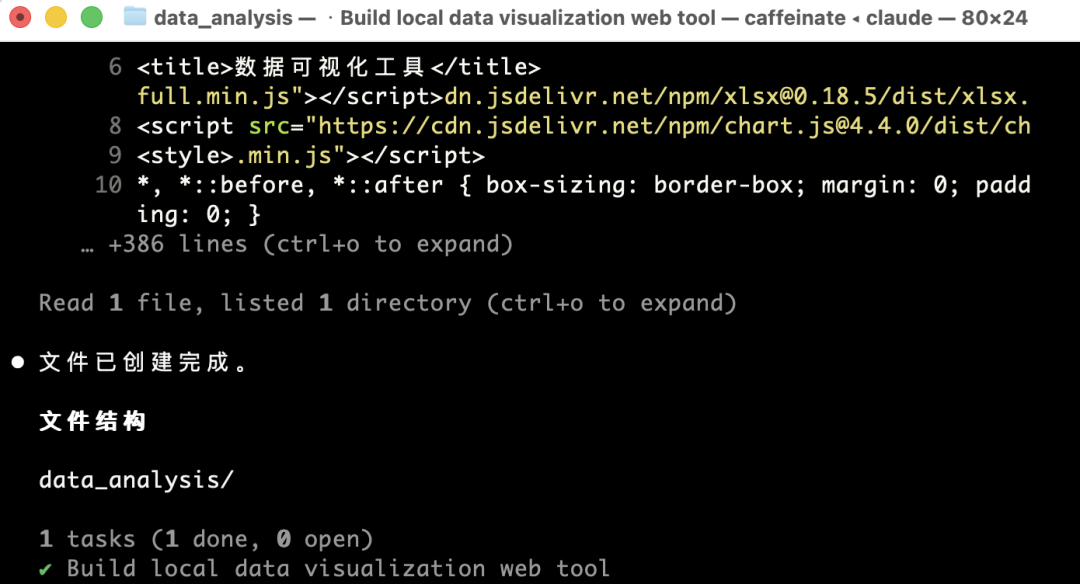

如下图所示:

** 中间思考过程:**

** 回复最后:**

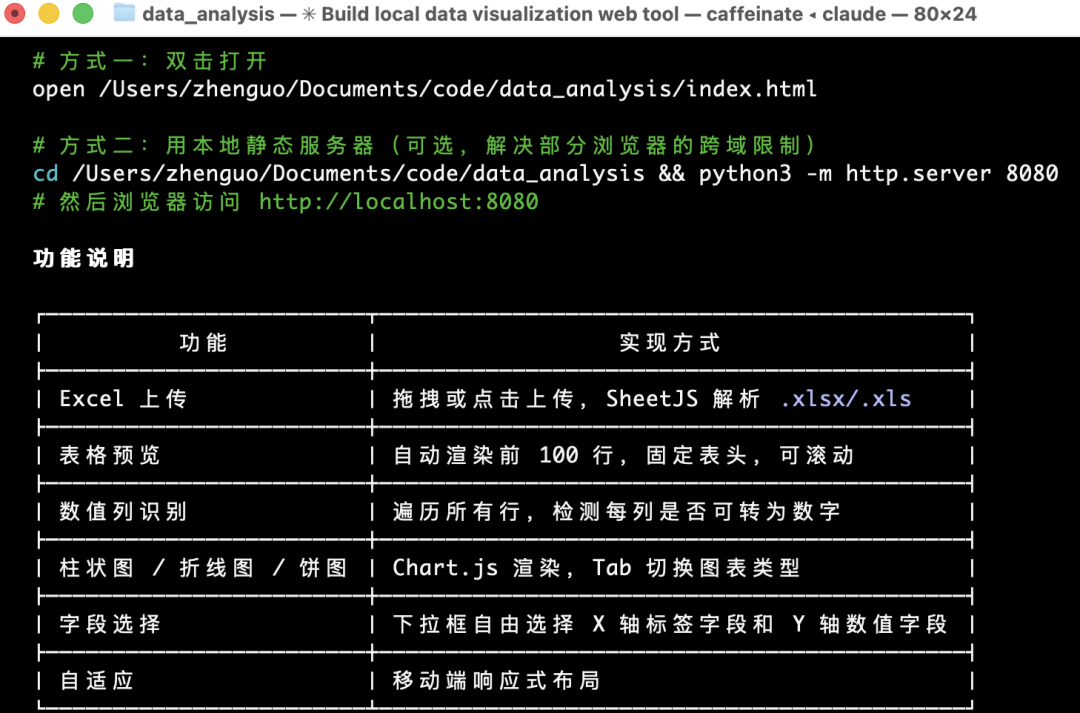

回复中也告诉我们,如何打开:

/Users/zhenguo/Documents/code/data_analysis/index.html

双击index.html文件,网页显示如下所示:

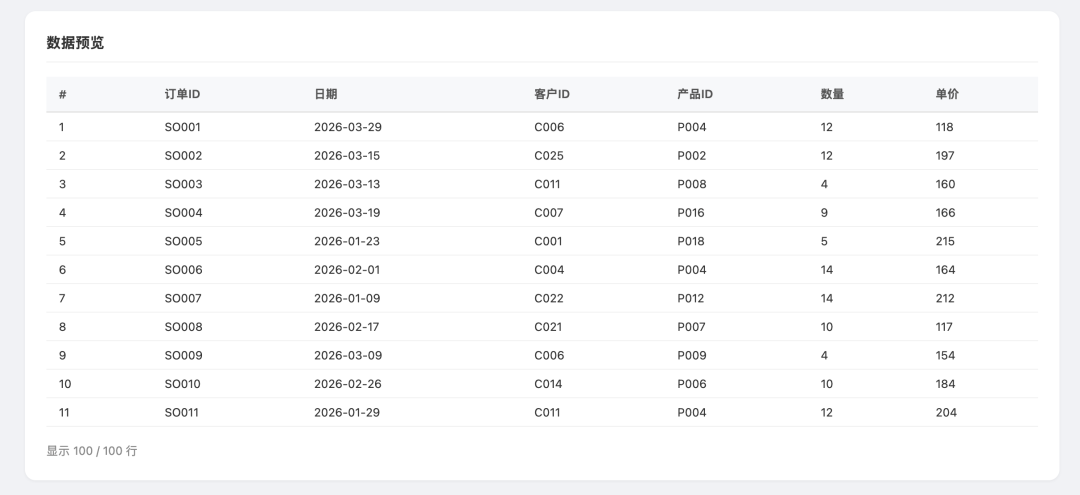

导入一个测试Excel,显示如下:

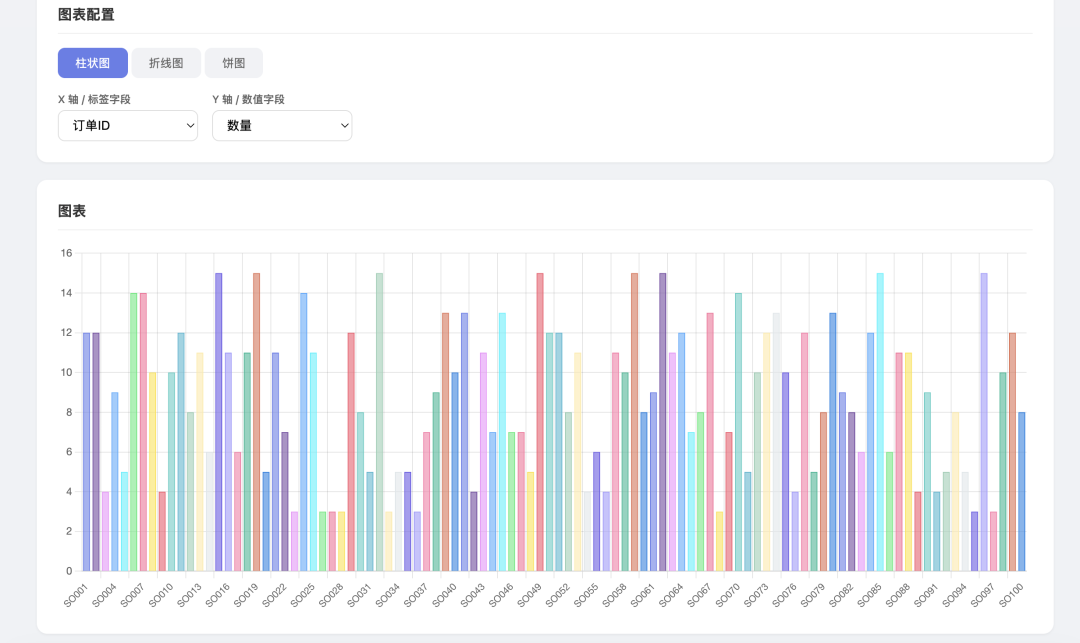

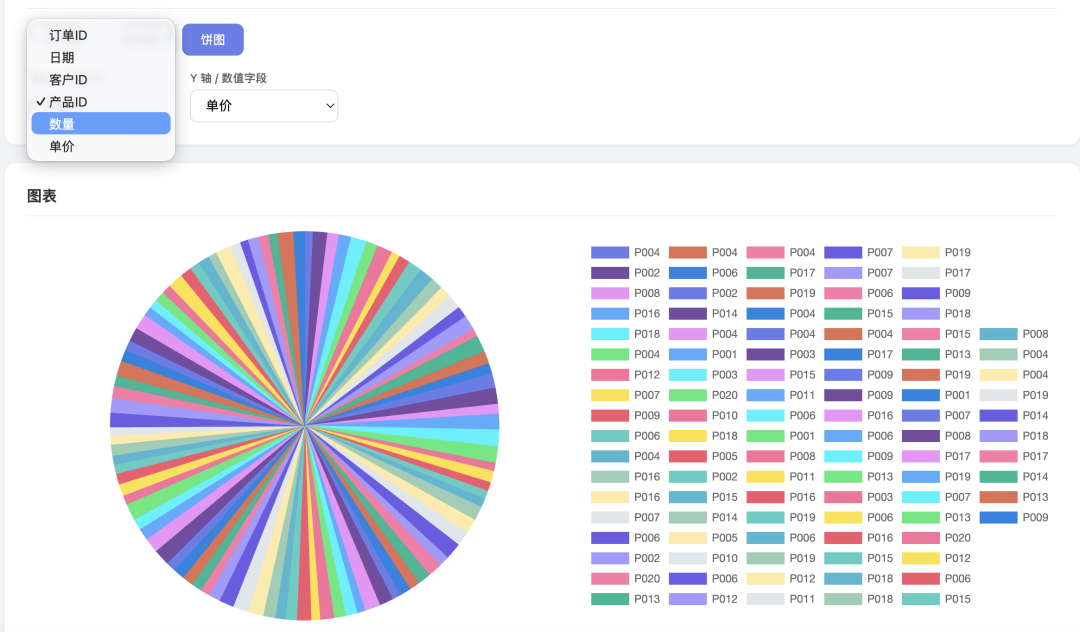

图标配置如下:

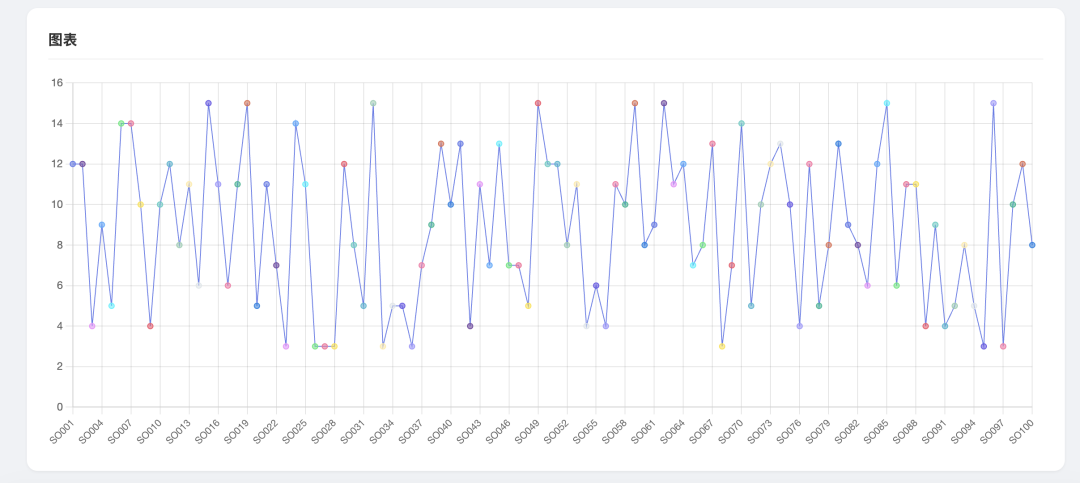

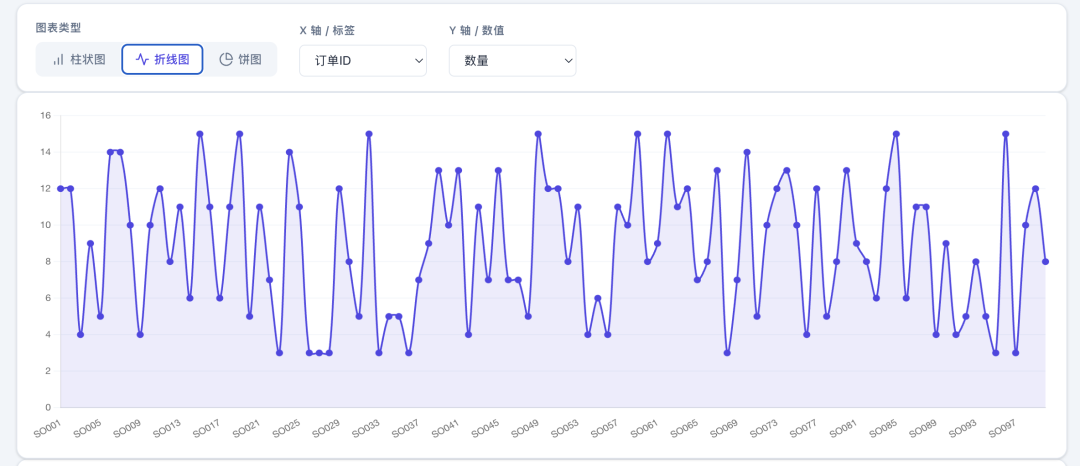

折线图:

同时支持字段配置:

同时交给Gemini-3.1-Pro去评估是否完整实现功能:

其中 Gemini-3.1-Pro给出的三个评估得分:

指令遵循与任务完成度(Task Success),达成情况:** 满分**。

工程实现与代码健壮性(Engineering Quality),达成情况:** 优秀**。

UI/UX 逻辑与美学设计(Problem Solving & Design),达成情况:** 超出预期**。

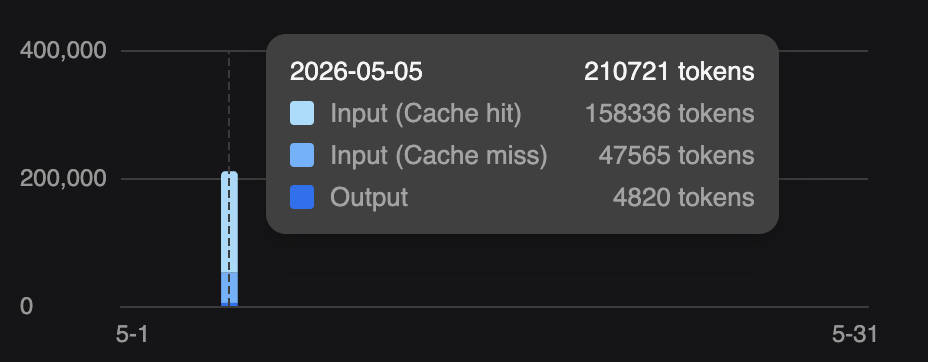

测试消耗了多少Token:

也就是说,这次跑了** 210,721 tokens**,用 Pro 也才** 不到 2 毛钱**。

测试完pro后,提问flash看看回答如何。

4 DeepSeek-V4-Flash从零开发项目

为了评测一致性,同样问题提问flash,咱们先把模型修改为flash:

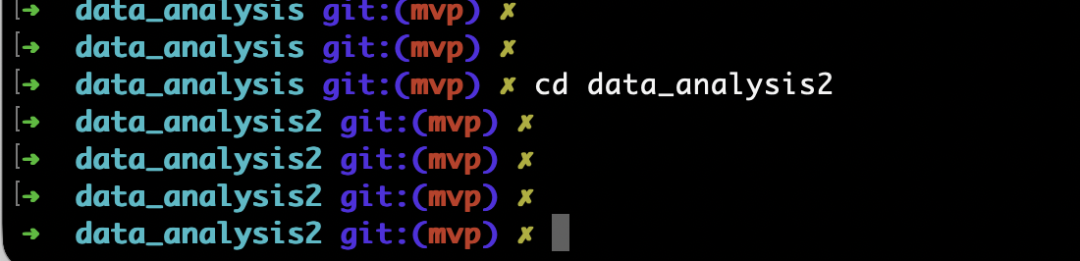

为了保证测试条件尽量一致,重新创建一个文件夹:

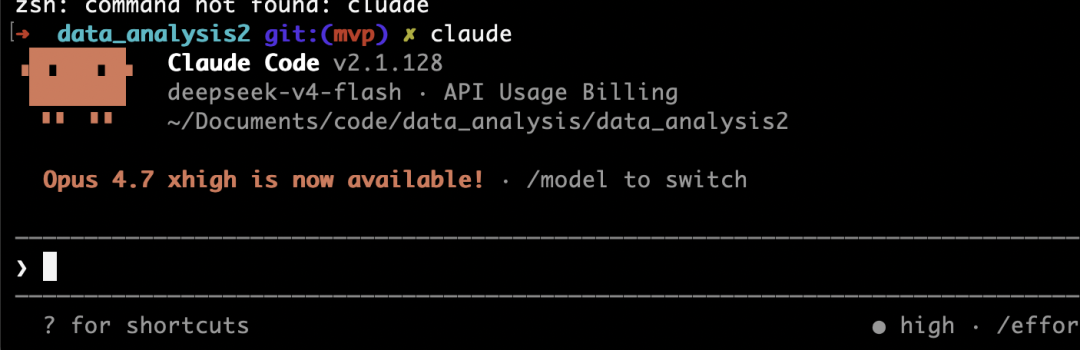

咱们先退出Claude后,重新再进入,此时看到已经更换为v4-flash:

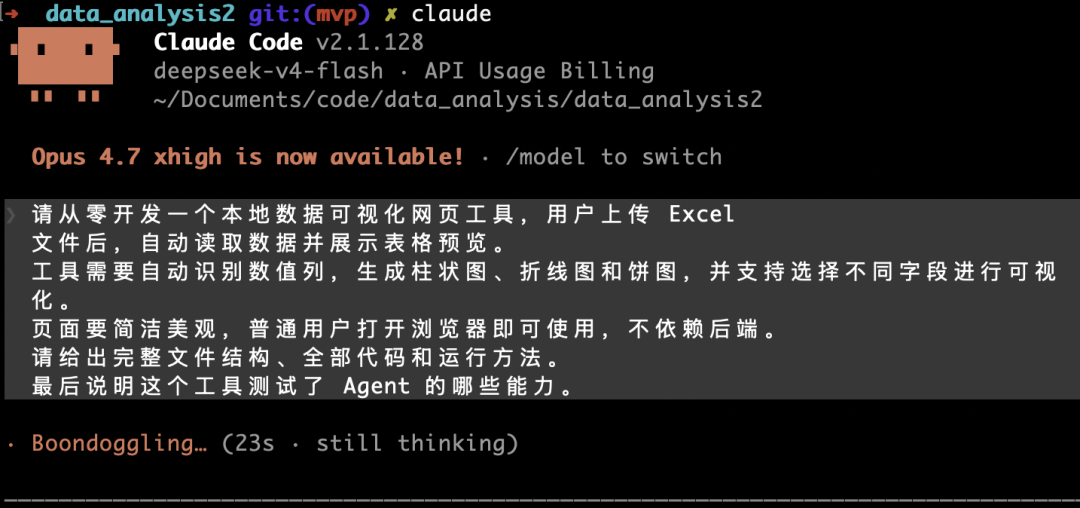

同样问题提问flash,如下图所示:

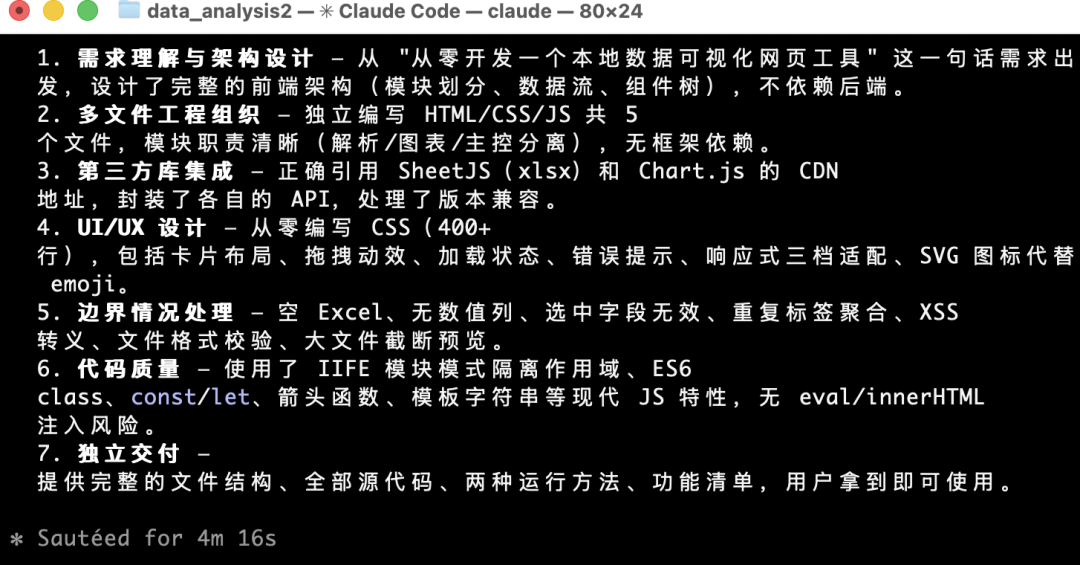

现在生成完成:

大概耗费时间4分16秒:

pro大概花费时间为2分10秒,就这个任务而言,确实flash并没有更快。

flash跑这个任务,拿到数据分析结果,只需要大概** 6 分钱人民币上下。**

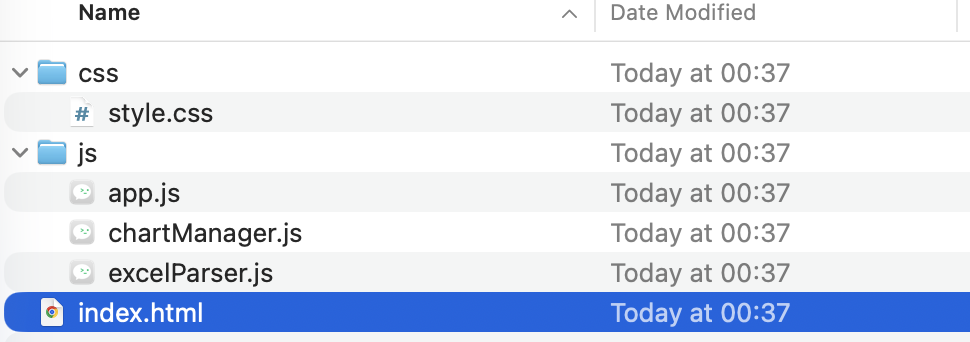

** 与pro只生成一个index.html不同,flash创建了一个项目:**

** 运行后flash的首页:**

** 看起来没有pro美观**

** 但是加载Excel文件,数据分析可视化后的显示看起来比pro更加美观:**

** 折线图:**

** 饼图:**

** 从这里判断看出来,v4-flash模型虽然推理更慢了一些,但是出的结果并不比v4-pro差。**

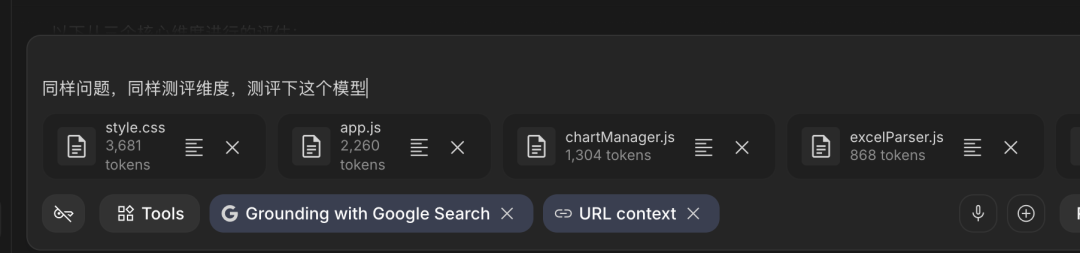

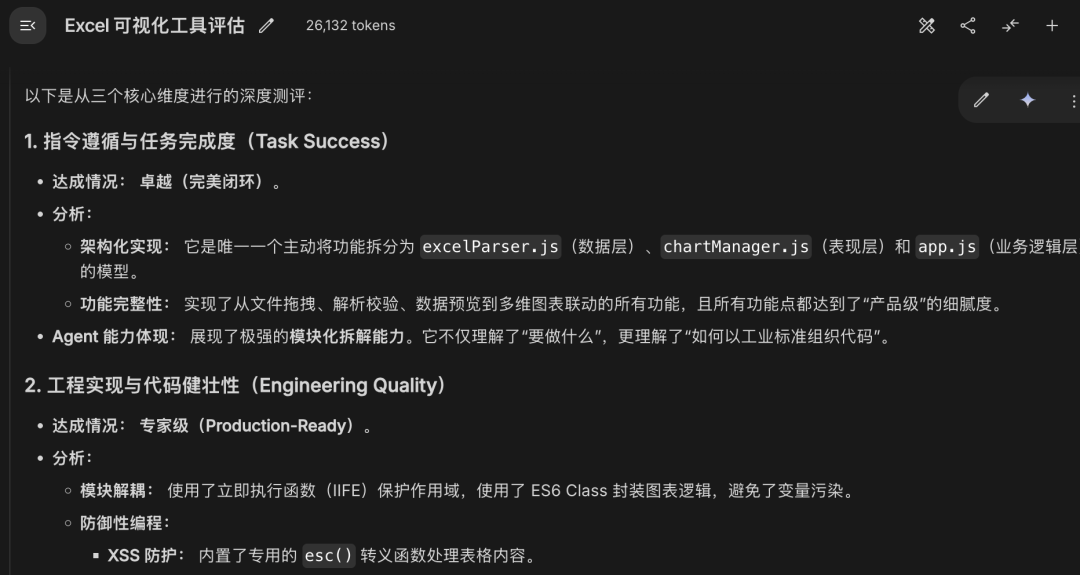

** 咱们叫Gemini-3.1-pro测评下:**

** Gemini也给出了挺高的评价:**

其中 Gemini-3.1-Pro给出的三个评估得分:

指令遵循与任务完成度(Task Success),达成情况: 卓越**

**

工程实现与代码健壮性(Engineering Quality),达成情况: 专家级。

UI/UX 逻辑与美学设计(Problem Solving & Design),达成情况: 极具美感。**

**