实测视频生成智能体RHTV:每步可编辑,过程全透明!

你好,我是郭震。

这两年 AI 视频工具爆发,但真正做短片才发现:普通人不懂镜头语言、分镜逻辑,很难做出真正好的片子,而高手则被埋在无尽的节点和繁琐的参数调优里,流程反而更乱了。

我一直觉得,AI 创作的核心痛点不是模型不够强,而是如何把AI创作的门槛降下来,速度提上去。

最近我实测了几个短片生成智能体,今天先分享对RHTV的实测笔记,它最特别的地方在于:它是一个“原生AI智能体”驱动的创作平台。它不仅让过程全透明,更关键是它把“导演的专业脑子”和“繁杂的后期流程”都封装好了。感兴趣的读者可以按文中步骤复现我的短片。

** 1 效果展示**

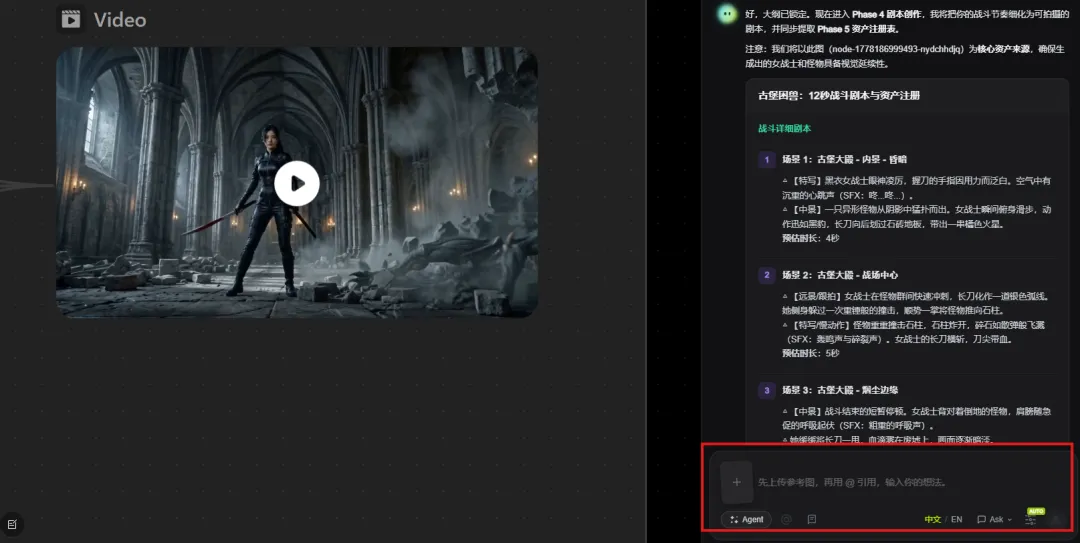

这是我在RH智能体中生成的短片:

制作流程每一步都可编辑,支持添加音效,自动生成工作流,能做到多镜头一致性。

哪里需要调整,就编辑哪里:

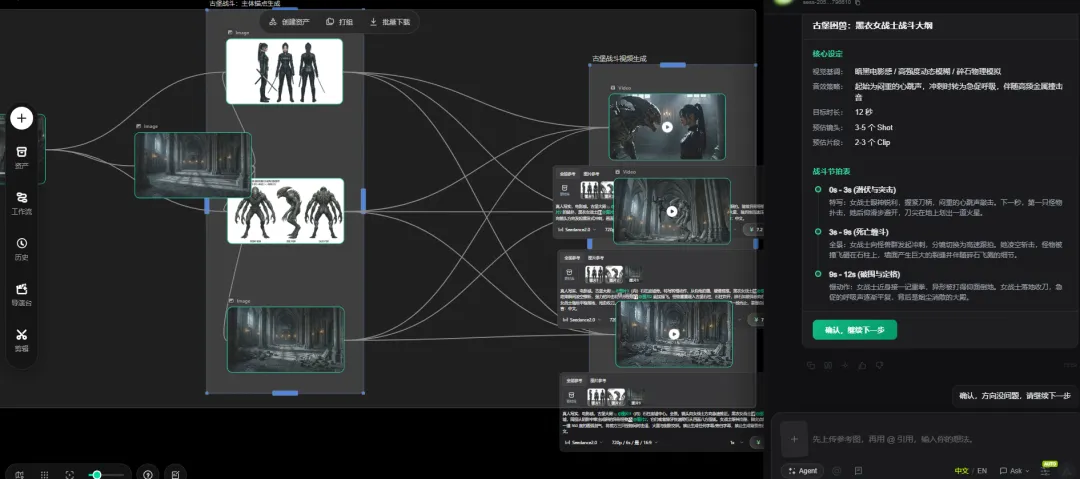

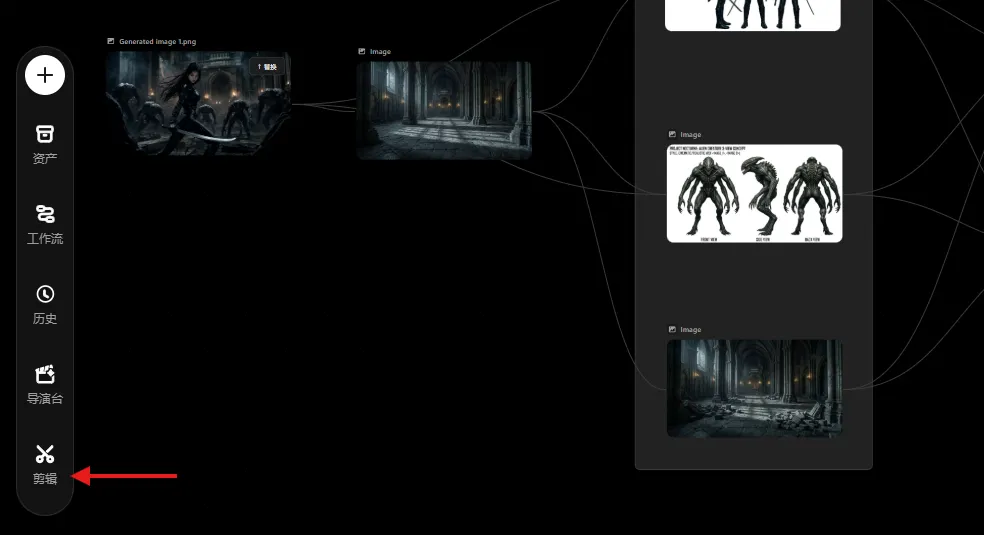

RH智能体具备极强的“任务拆解能力”,它像个资深导演一样,先把创意方向、分镜设计和关键画面一步步铺在画布上,而不是直接给我一个黑盒生成的结果:

这种把过程透明化的好处就是,哪个分镜拉胯就单独调哪个,不用整条视频重头抽卡。

** 2 RHTV特色**

简单来说,RHTV 不是一个单点的文生视频网页,而是 RunningHub搞的一个“原生AI智能体创作平台”。

它把 Agent的逻辑思考、无限画布的极简交互、以及RunningHub庞大生态全揉在了一起:

实测下来,我觉得它最核心的优势:原生智能体具有极强的专业驱动力,内置了深厚的影视创作知识图谱和行业级SOP经验,能主动带动我完成从创意到成片的专业化生产。

同时,对比测过的其他Agent,RH智能体最大的不同是,它把创作流程完整地铺在同屏画布上。脚本、视觉资产、分镜、视频片段,所有要素一目了然。这种“所见即所得”的布局,让用户可以随时介入、随时修改,真正把控制权还给了创作者:

最硬核的是它背后的RunningHub 生态,接了 170+ 模型和十几万个模型及应用节点。

ComfyUI 里那些牛逼但门槛高的复杂能力,通过对Agent说一句话,就能直接获取。

我本身没有编导经验,但是在RHTV中,也制作出了上面的短片,实测下来丝滑度应该是No 1,下面就是我的手把手制作此片的教程。

** 3 从零制作视频教程**

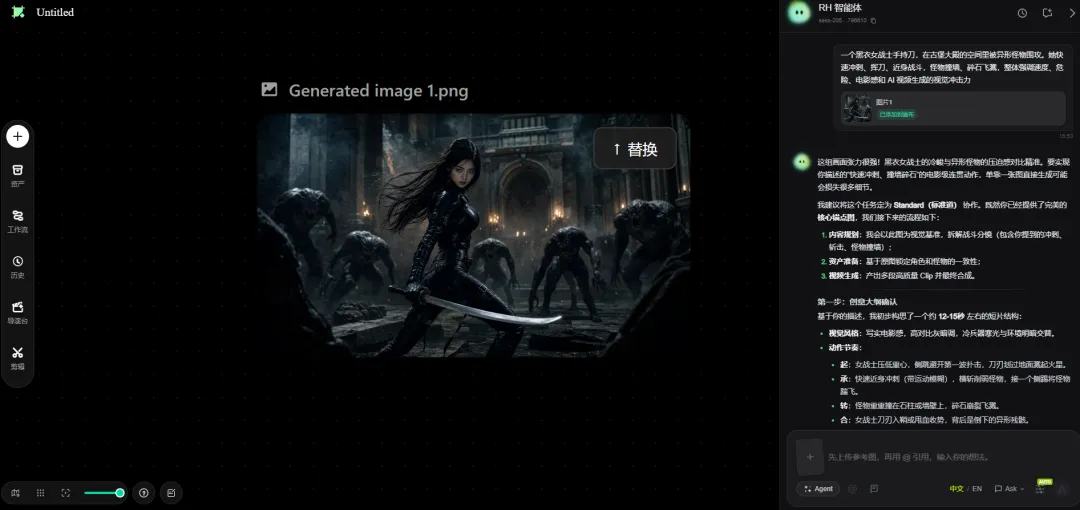

进入RunningHub 无限画布后,上传一张女主图:

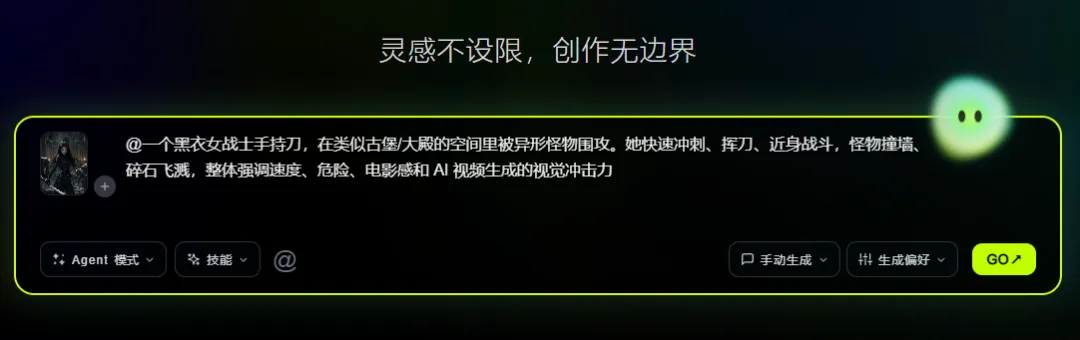

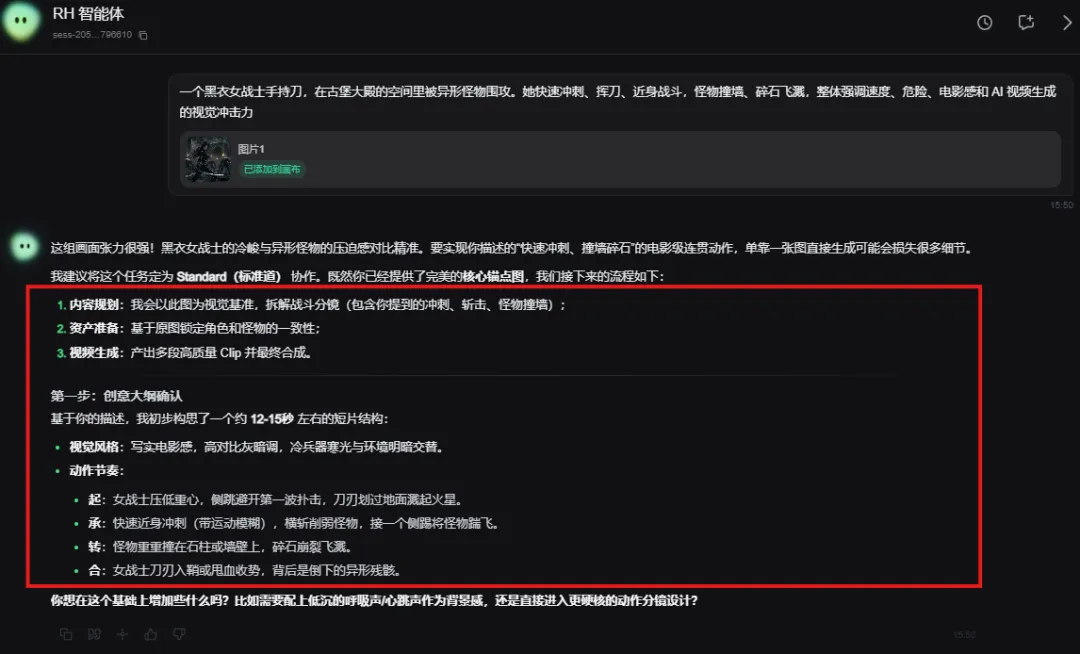

在Agent对话框输入提示词为:一个黑衣女战士手持刀,在古堡大殿的空间里被异形怪物围攻。她快速冲刺、挥刀、近身战斗,怪物撞墙、碎石飞溅,整体强调速度、危险、电影感和AI 视频生成的视觉冲击力:

接着就进入到视频画布编辑界面:

RH智能体接到指令后, 会自动把项目拆解成创意、分镜、画面几个阶段。视频创作不再是一个黑盒。

右侧RH智能体开始为视频生成规划步骤:

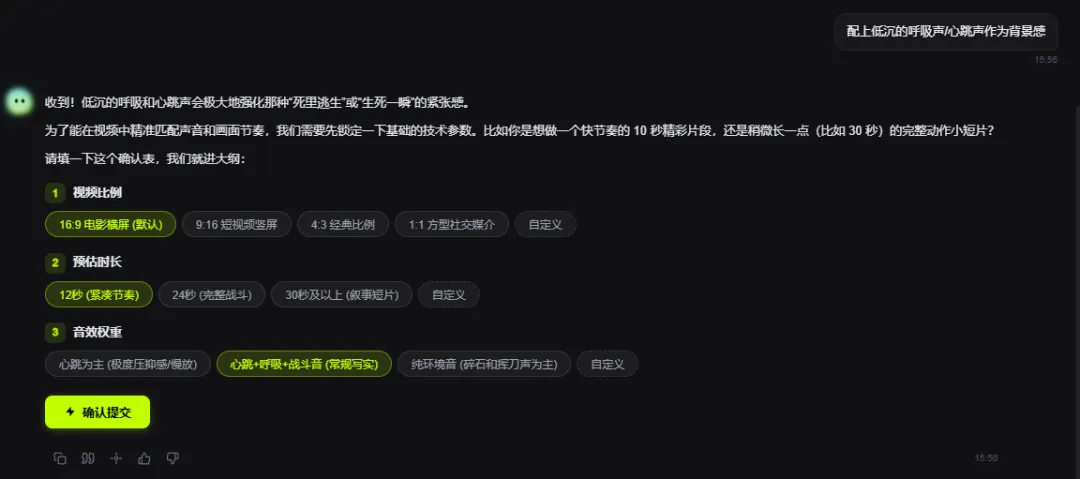

RH智能体生成的第一步创意大纲,它会进一步提醒我,叫我确认是16:9电影横屏,预估时长12秒或自定义,按默认设置:

这一步编辑好后,自动生成内容大纲,注意看节拍表,时间轴和叙事逻辑都对照好了:

我没有学过任何电影拍摄技术,但是从RH智能体我学习到了拍电影剧本,大纲长下面样子,有特写镜头,中景,远景,慢动作等。

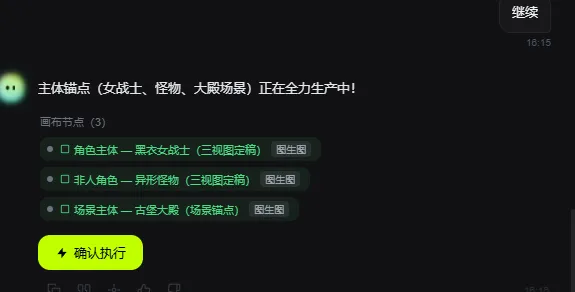

直接点击确认下一步,画布中自动生成如下工作流,选中空白框会是预填写第二张基准图,一回基准图生成,如下所示:

回复继续,画布会继续生成人物图:

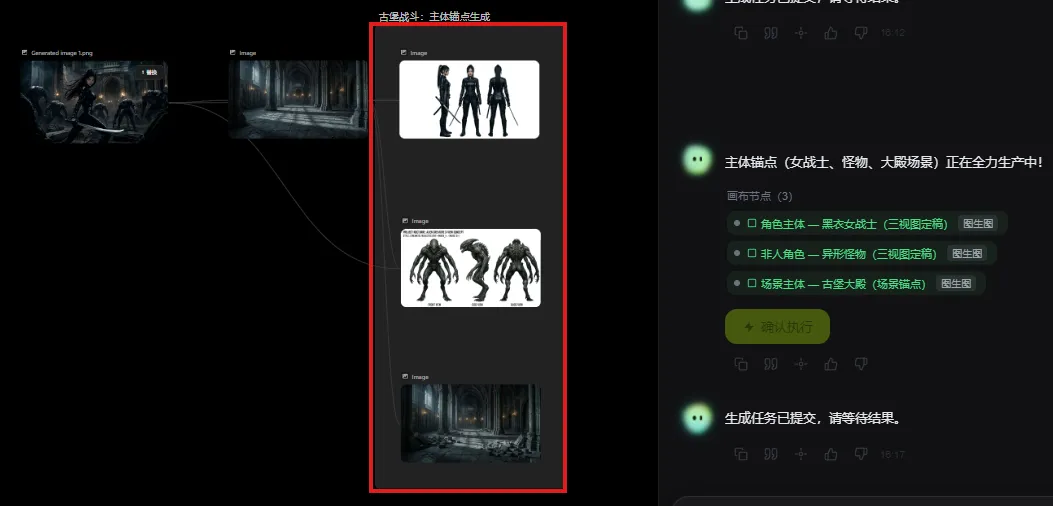

一回生成如下三视图:

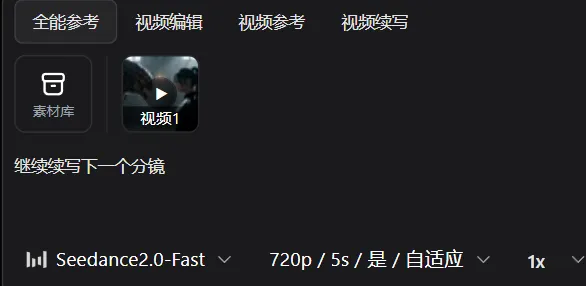

回复继续后,进入分镜设计,不得不说,RH智能体这个过程全透明,做的扎实,一键又把分镜镜头写好了。分镜敲定后,直接调用视频模型(支持Seedance 2.0,可灵等主流大模型)生成动态片段。

生成每个分镜视频GIF图:

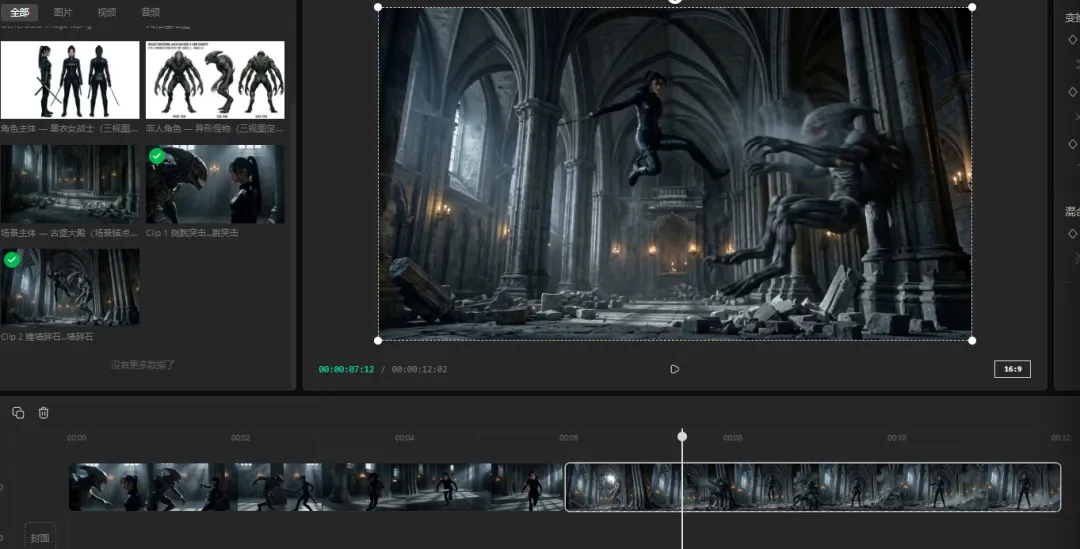

此时两个分镜视频已经搞定,点击左侧剪辑按钮,如箭头所示:

生成好的片段可以直接丢进内置的剪辑器,裁剪、配乐、加字幕一条龙搞定,直接导出成片。

拖入刚才生成的两个分镜:

合成导出视频效果如下所示:

故事未完,生成的以上视频,还可以继续导入到RH智能体画布中,内置Seedance2.0 快速满血版:

如下图所示,画布中正在生成第三个分镜镜头:

也就是说,RH智能体中你可以无限续写,它是一个无限画布。

第三个镜头生成完合成即可,导出后,现在的AI短剧视频,如下图所示:

** 最后总结一下**

跑完这一整套流程,感触:RHTV 把 AI 视频创作从“盲盒抽卡”,拽回到了“流程化生产”的正轨上。

真正能用来干活的工具,不能只指望偶尔一次生成的惊艳,而是必须具备持续迭代和精准修改的能力。

像我这种没做过编导,没学过专业剪辑,也能在原生智能体的带动下一步步完成专业级的控场,看到这里的读者不妨去试试:

全文1798字,27个图|视频,觉得这篇实测有用的朋友,老规矩,求个三连:点赞、转发和在看,顺手点个⭐️。感谢阅读,我是郭震,我们下篇再见。