终于DeepSeek-V4 能本地部署了,普通电脑也能跑!

你好,我是郭震

DeepSeek-V4 发布两周,如何部署到本地跑,很多人感兴趣。

现在终于有方法,我第一时间,实测了下,感兴趣的可以看下。

1 本地部署DeepSeek-V4

使用社区,DeepSeek-V4的蒸馏版,发布三天下载就好几万了,足见大家对V4的喜爱:

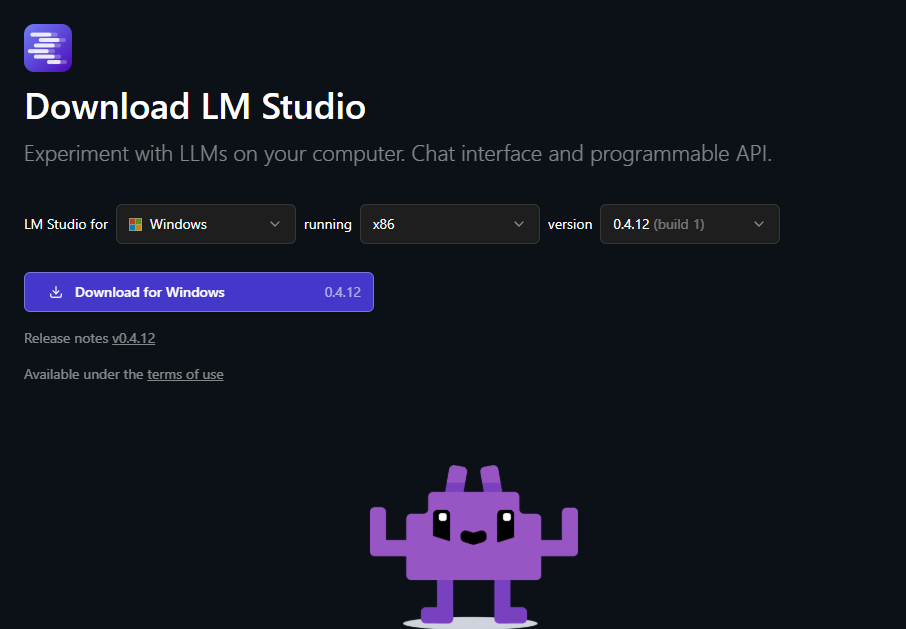

安装DeepSeek-V4蒸馏本地部署版,先下载 LM Studio:

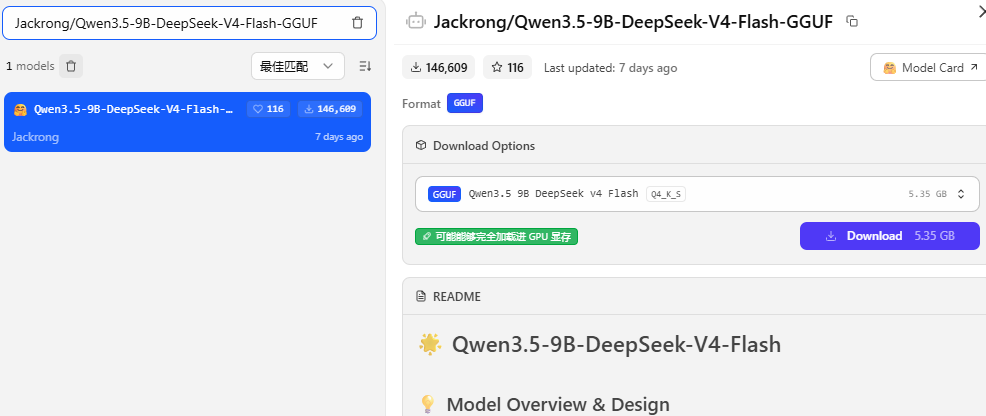

在搜索模型中,找到此模型,如下所示:

Jackrong/Qwen3.5-9B-DeepSeek-V4-Flash-GGUF

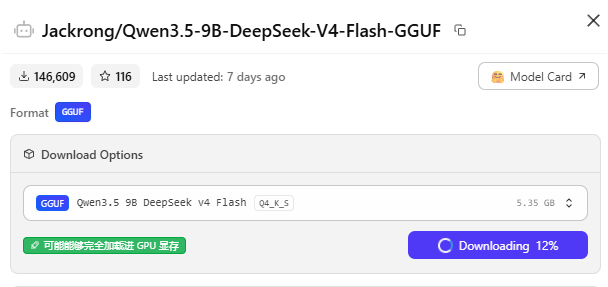

找到后,点击下载,如下图所示已下载12%:

这个模型是基于** Qwen3.5-9B** 做的 DeepSeek-V4 蒸馏版。简单理解,就是用 DeepSeek-V4-Flash 的高质量推理数据,去增强一个 9B 小模型,让它尽量学到结构化推理、多步分析和工具调用能力。

它的优势是体积小、部署门槛低。比如 GGUF 的** Q4_K_M** 版本大约 5.63GB,普通本地电脑也有机会跑起来。

这个模型主要面向结构化推理、快速本地推理和工具增强工作流。

我的定位是:** 适合个人电脑低成本体验 DeepSeek-V4 推理风格,用来做本地知识库、Agent 和自动化工作流测试。**

** 2 测评蒸馏V4**

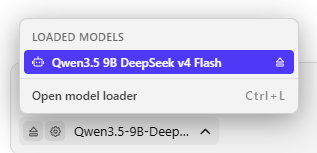

下载完成后,加载使用:

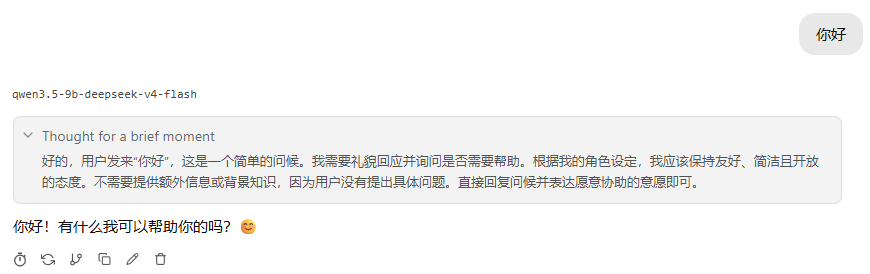

LM Studio 中使用它回答问题:

问一个简单编程题:

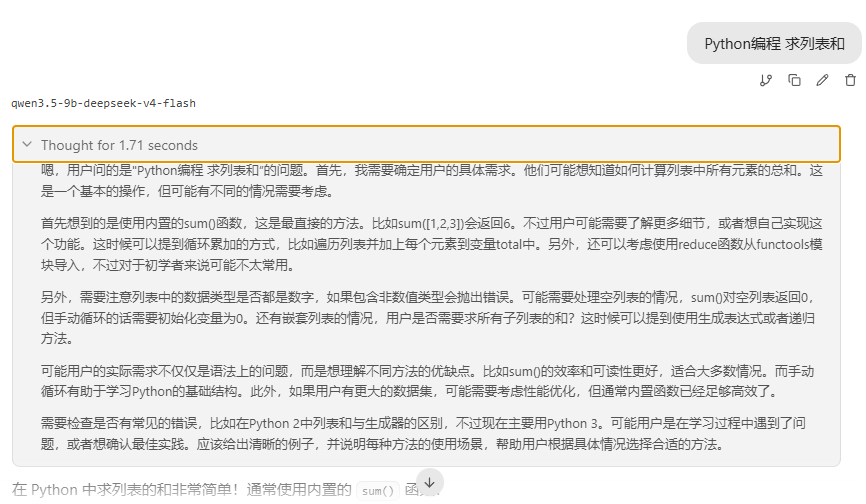

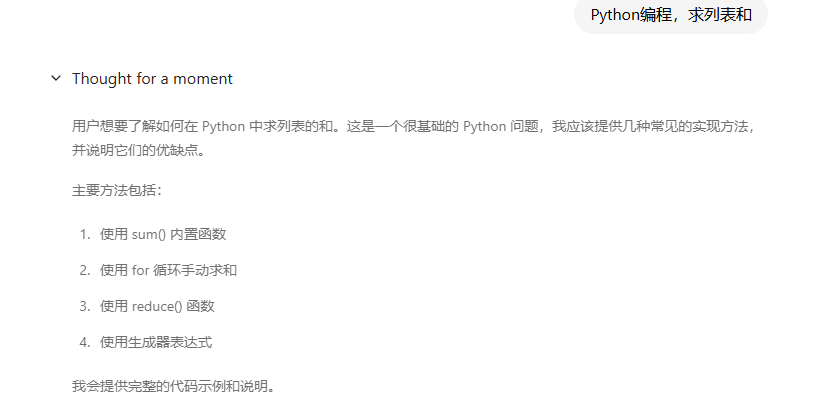

问原来的9B模型,看看它的思考过程:

我是在Ollama里直接提问Qwen3.5-9B模型,因为已经安装,不想再在LM Studio安装一遍。

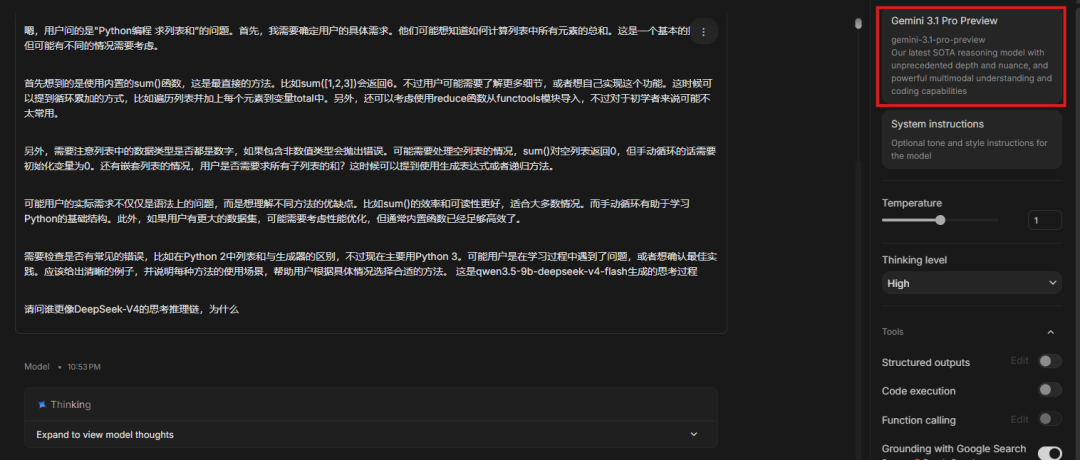

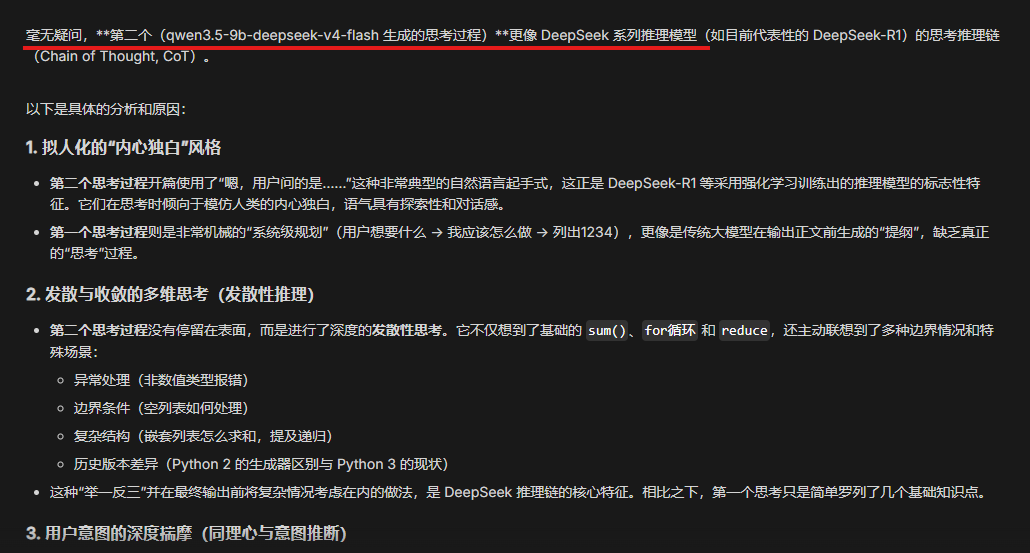

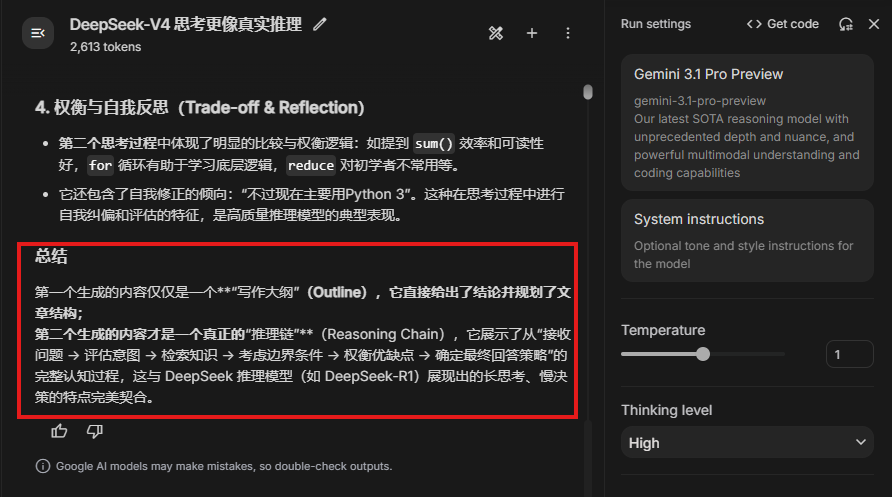

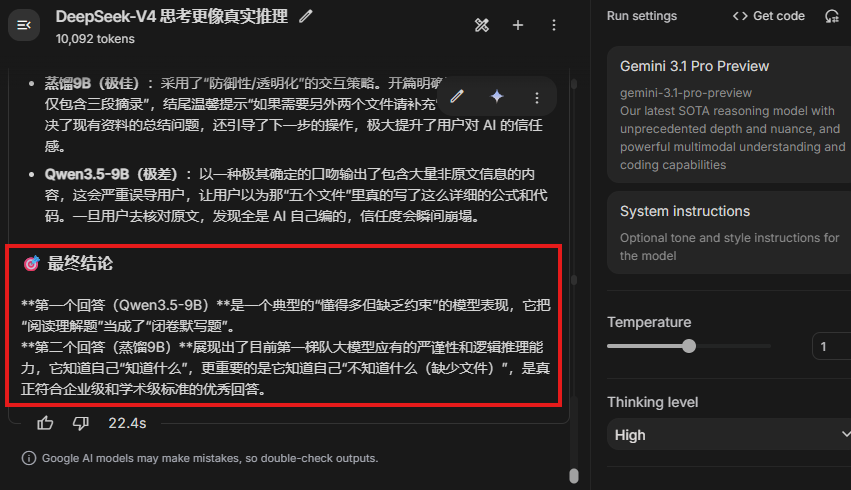

如果测试蒸馏后的9B模型是否更像DeepSeek-V4,我把以上两个模型的思考过程发给Gemini-3.1-Pro,让它评论谁更像DeepSeek-V4:

看到Gemini给出结论,蒸馏后的9B更像DeepSeek:

总结如下:

第一个生成的内容仅仅是一个“写作大纲”** (Outline),它直接给出了结论并规划了文章结构;**

** 第二个生成的内容才是一个真正的** “推理链”,它展示了从“接收问题 -> 评估意图 -> 检索知识 -> 考虑边界条件 -> 权衡优缺点 -> 确定最终回答策略”的完整认知过程,这与 DeepSeek 推理模型(如 DeepSeek-R1)展现出的长思考、慢决策的特点完美契合。

结论:蒸馏9B实打实模仿到了DeepSeek-V4,石锤!

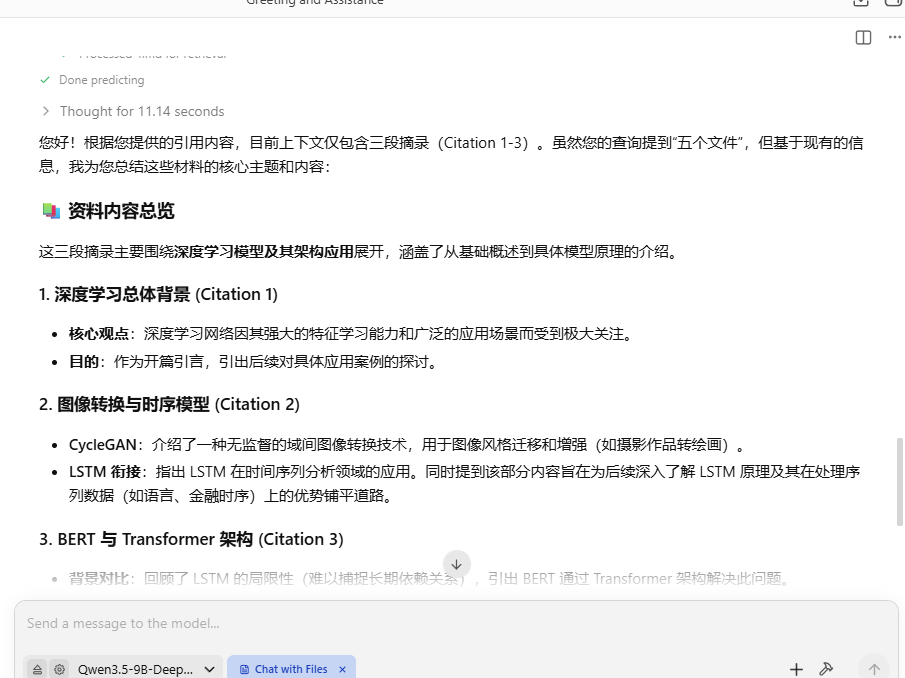

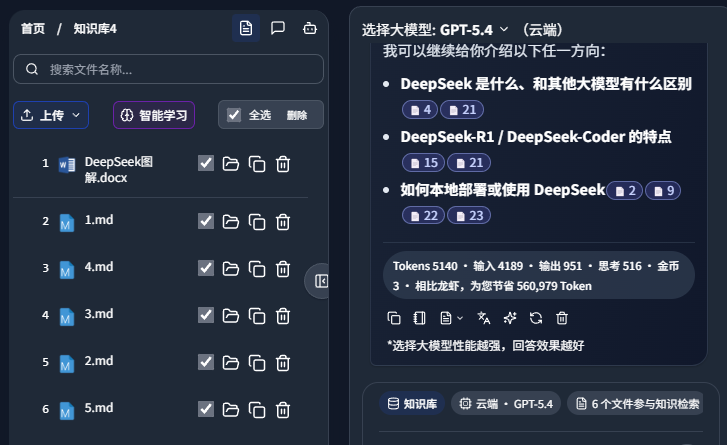

3 接入知识库

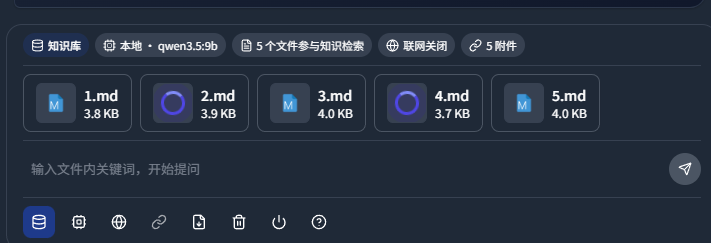

LM Studio 做知识库,限制就是最多上传5个文件,低于30M:

咱们先初步测试下RAG效果:

生成答案如下所示:

同样问题,我们提问DeepSeekMine,这个知识库我们团队研发,支持上传上万文件。

如下所示我的电脑1万4千文件全部扔进去了:

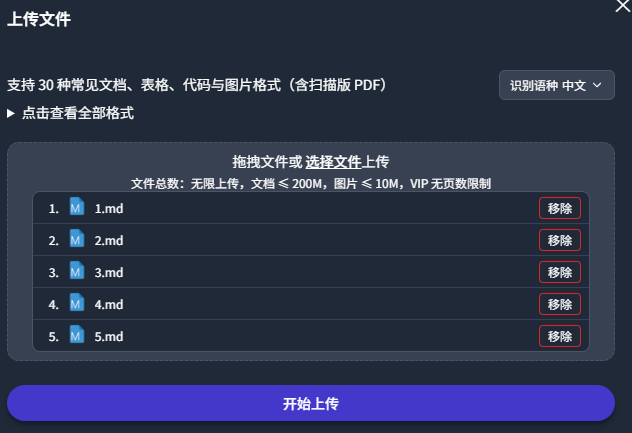

上传同样这五个文件:

可以看到文件总数,我们无限上传,最大支持到200M单文件。如下所示正在上传:

如下图所示上传完成:

DeepSeekMine除了支持远程如GPT,Gemini等外,还支持本地配置本地大模型:

配置本地大模型,使用本地算力,0成本养一个知识库。

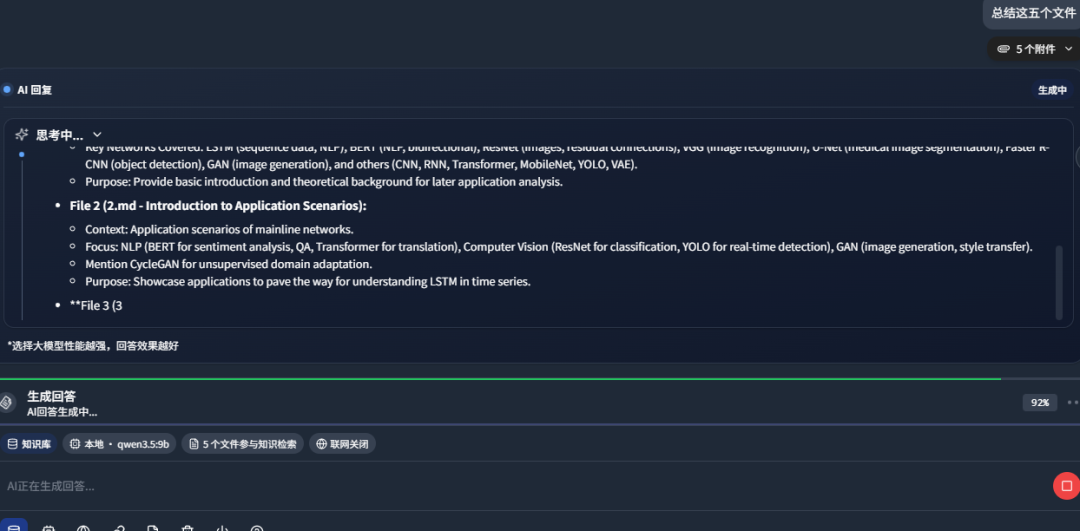

如下提问它,对于总结类问题直接加载5个文件,回答总结会更好,如下图所示:

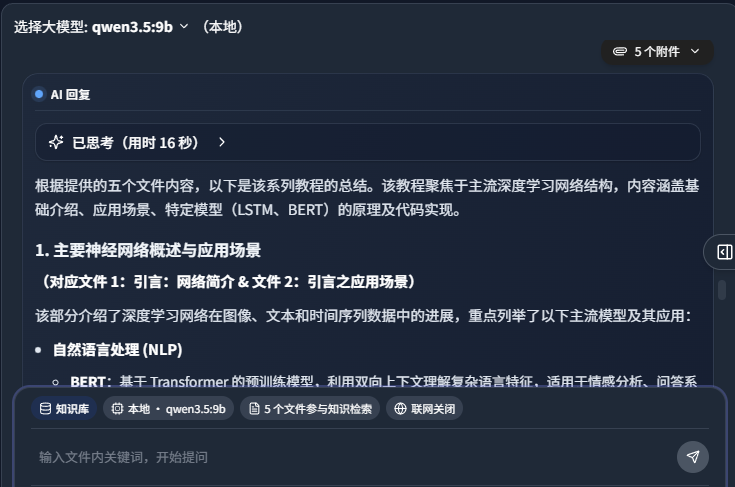

看到原来Qwen3.5-9B的思维链:

思考16秒给出的总结:

看到蒸馏后的9B大模型,总结文档也要好于原来的9B:

结论:做RAG,蒸馏的9B模型也更适合、更强大。Gemini给出的结论就是蒸馏9B已经够到第一梯队。

总结一下

DeepSeek-V4蒸馏版在本地电脑部署后,本文实测了其回答效果。

不管回答问题,还是做知识库,蒸馏DeepSeek-V4的9B好于原来的9B,感兴趣的可以按照文中步骤去体验。