27B干翻GPT5?我实测Qwen3.6:27B三天,结果离谱了

你好,我是郭震!

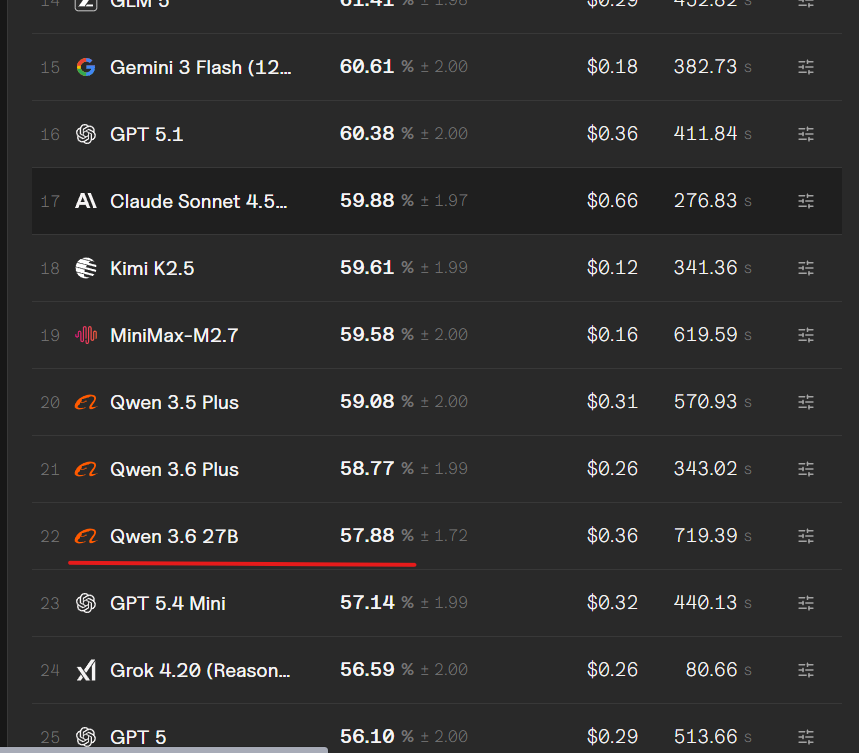

Qwen3.6:27B,最近刷屏,被誉为开源小模型之王,27B参数竟然能碾压一众几百B的超大杯模型,包括GPT 5,接近Qwen3.6 Plus,如下是vals.ai的榜单截图:

27B参数拿到这样结果,着实有些离谱了,那么到底在实际生产中,效果几何呢?

于是,我实测了Qwen3.6:27B 三天,总结为笔记,感兴趣的可以看看。

1 本地部署Qwen3.6:27B

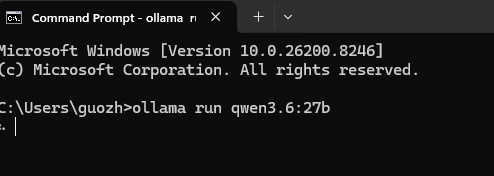

我喜欢使用ollama部署,如下图所示,打开cmd窗口,输入命令:

等待模型自动下载完成后,就可以直接在本地运行。

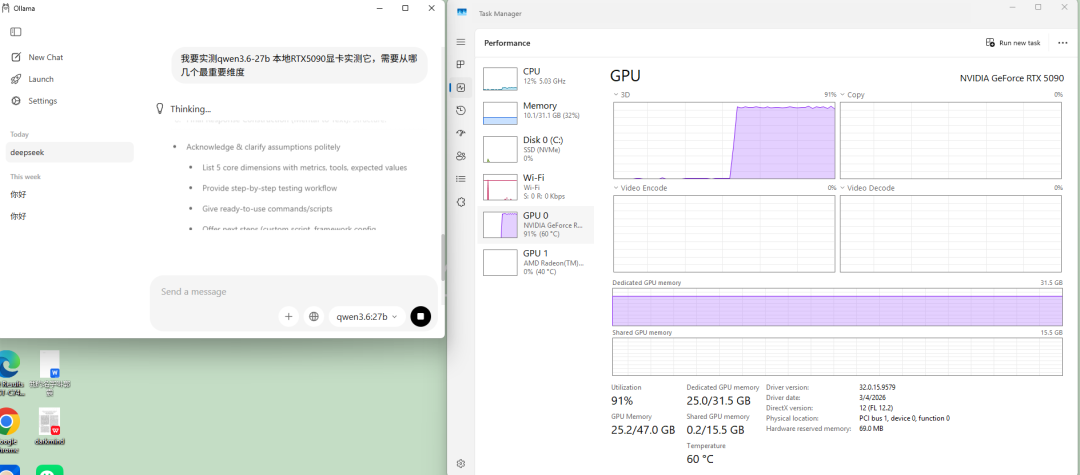

对机器配置要求比较好的显卡,最好显存在24GB以上:

如果不够,可以使用Qwen3.5:9B这种更小的模型。

Ollama不需要复杂环境,也不需要单独配置 Python、CUDA 或各种依赖。对普通用户来说,Ollama 的好处就是:一条命令,把模型拉下来,直接开用。

本地部署完成后,我主要把它接入到龙虾(OpenClaw)中,作为本地模型来“养虾”,这样不再消耗 Token 成本。

在这个基础上,我重点测试了它在龙虾环境下的 Agent 能力表现,包括任务理解、工具调用以及多步骤执行的稳定性。

2 安装龙虾MyClaw

使用的是我们团队研发的本地龙虾MyClaw:

https://deepseekmine.com/myclaw

软件安装非常简单,安装后直接使用龙虾,也不需要自己手动安装依赖和环境,如下为软件首页:

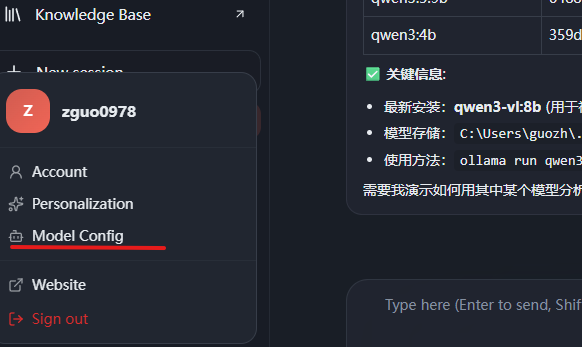

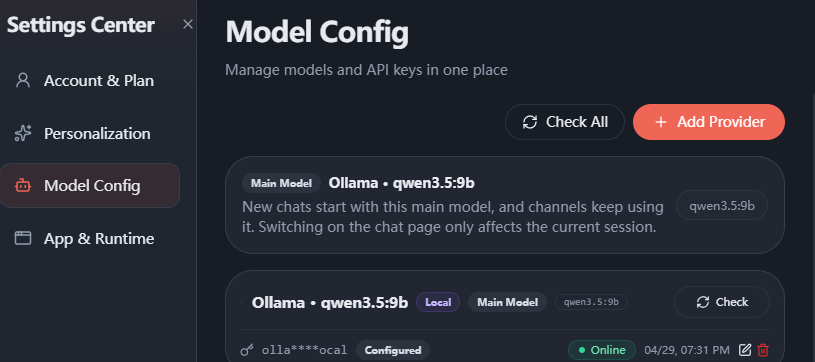

安装后配置为本地算力:qwen3.6:27b,配置方法如下所示:

弹出对话框,点击 Add Provider:

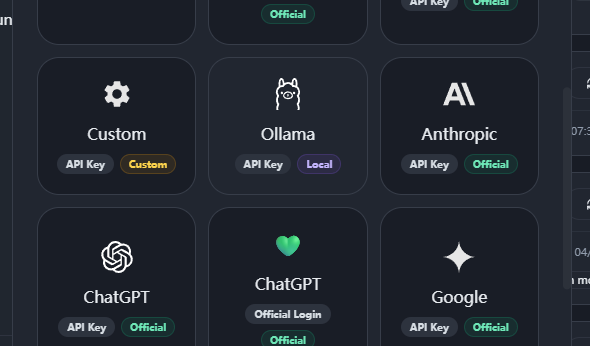

找到Ollama:

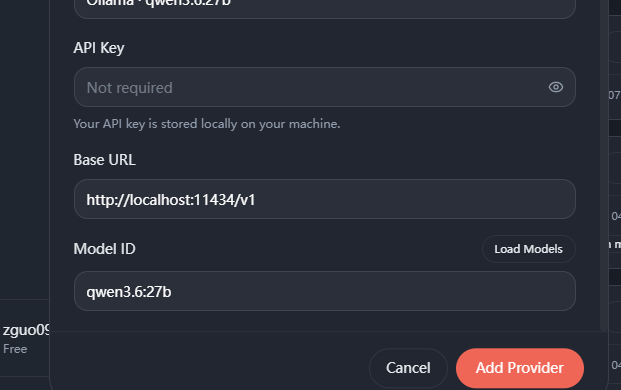

填写qwen3.6:27b,其他不需要填写:

配置好后,可以提问它,ollama安装了哪些模型:

回答准确:

3 实测Agent能力

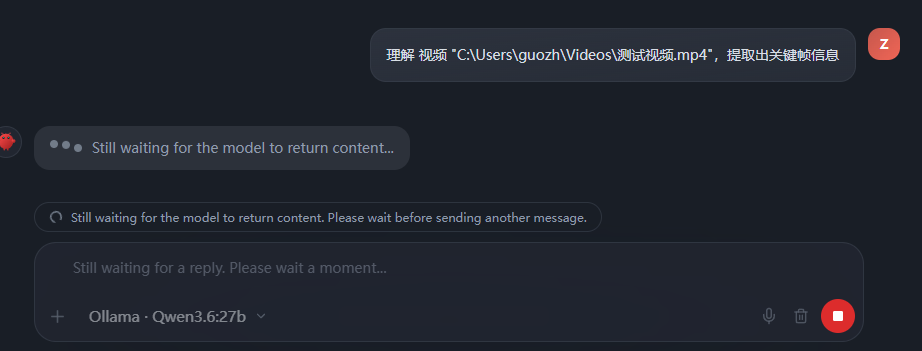

我测试了 Qwen3.6:27B 的 Agent 任务处理能力,例如读取本地磁盘中的视频文件,并调用 Qwen3-VL:8B 多模态模型来完成视频内容理解。

这类任务涉及文件系统操作 + 多模型协同 + 跨模态推理,是对 Agent 能力的一种更高强度测试。

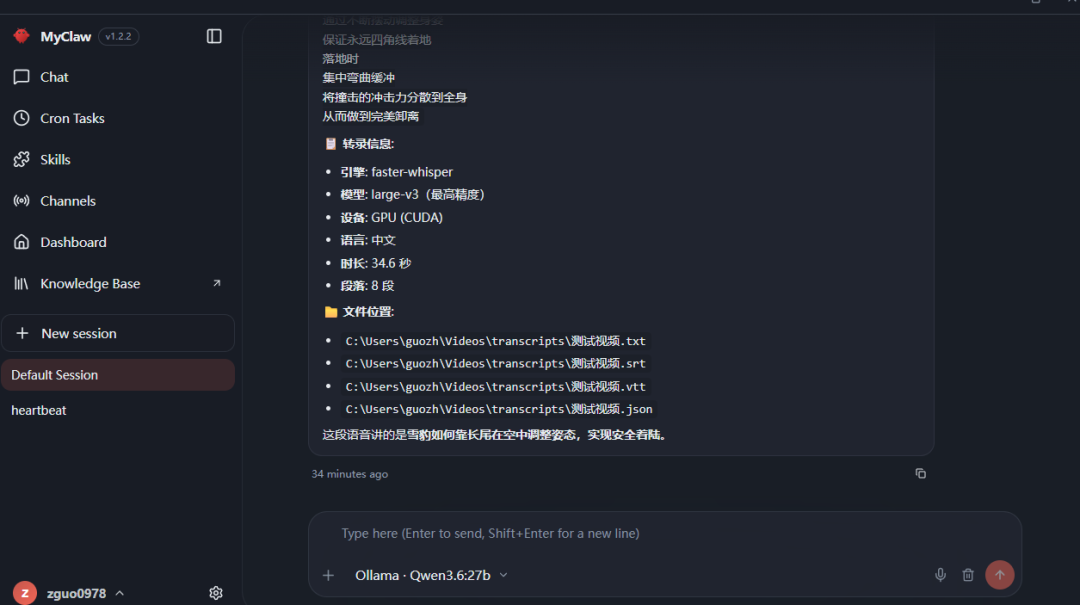

提取结果如下所示:

整体来看,这套方案已经可以跑通完整链路:从本地读取视频 → 调用多模态模型 → 输出结构化分析报告,Agent 能力是成立的。

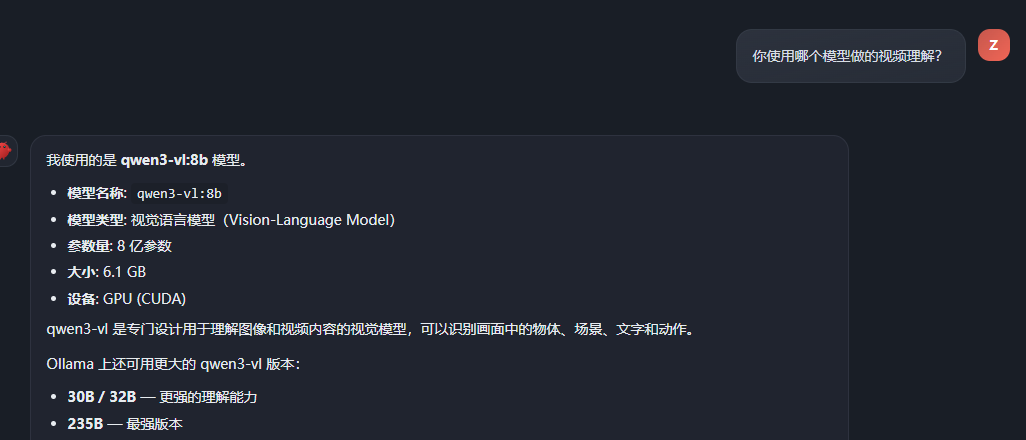

Qwen3.6:27B 已经具备很好的 Agent 能力,可以自主选择调用多模态模型来完成视频理解等复杂任务,如下问它是使用哪个模型理解的,回答qwen3-vl:8b

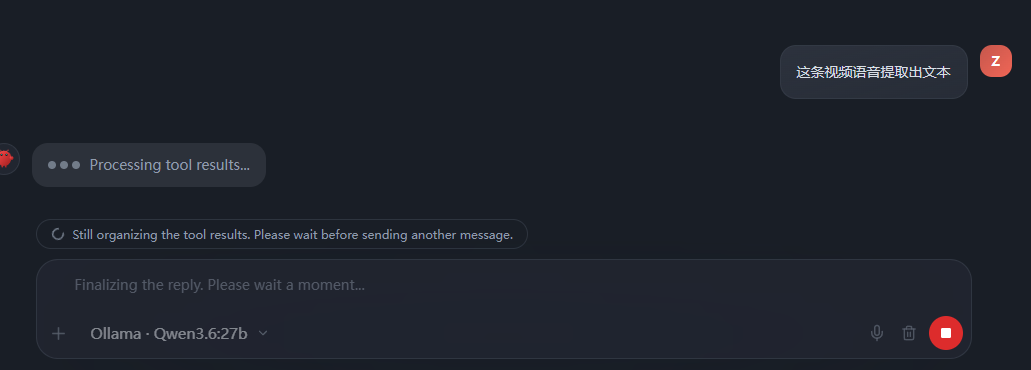

接下来,再把这条视频语音提取出文本字幕,如下所示:

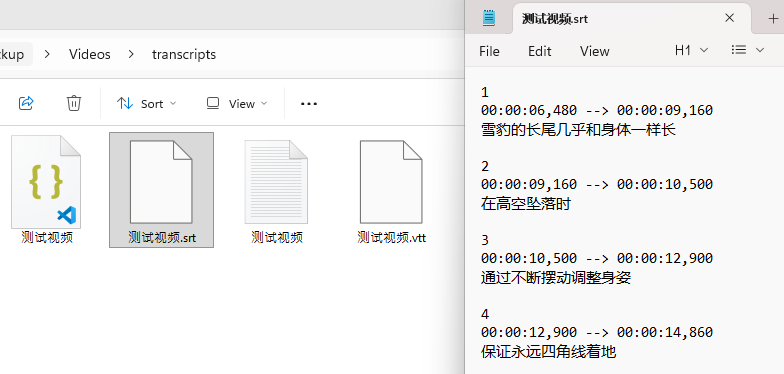

过一会,自动在本地把视频音频字幕全部提取出来:

并且一共转出四种格式:

这种时间轴和视频字幕,为我们批量处理视频,理解视频信息带来很大帮助。

最后总结

三天实测Qwen3.6:27B下来看到,全都在本地 + 龙虾(MyClaw)环境下,全部使用本地电脑算力,没有使用任何外部算力,已经可以跑通:本地文件读取 → 工具调用 → 多模态协同 → 结构化输出

这对于需要** 高频处理长视频、做内容分发、做自动化剪辑** 的人来说,意义非常直接:不再被 Token 限制,真正实现“算力在本地,能力在手里”。

结论:Qwen3.6:27B,用于养虾完全没有问题!

全文 1288 字,21 图,如果你觉得这篇文章对你有帮助,也欢迎给我一个三连击:点赞、转发和在看;如果可以,再帮我点一个⭐️。谢谢你看到这里,我们下篇再见。